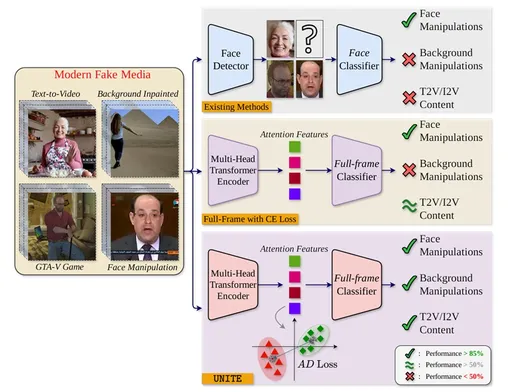

Традиционные детекторы поддельных видео сосредотачивались почти исключительно на лицах, что ограничивало их эффективность. «Дипфейки эволюционировали», — отмечает соавтор разработки Рохит Кунду. Современные генеративные модели позволяют создавать полностью синтетические видео — от лиц до фоновых элементов. Злоумышленники могут манипулировать сценой, искажая истину даже без изменения персонажей.

ИИ-модель научилась определять видеофейки, на которых лица реальны, а фон подделан

Существуют многочисленные способы подделать видео, не меняя ни лица, ни слов, которые говорит человек. Можно изменить локацию и показать реальное видео политика, выступающего в студии, на фоне разрушенного города или роскошной резиденции, создавая ложное впечатление о месте и контексте заявления.

К речи реального человека можно добавить фон с ликующими или протестующими людьми, кардинально меняя восприятие события. Особенно коварно то, что зрители обычно не подвергают сомнению фон: они концентрируются на говорящем. Если лицо и голос выглядят аутентично, мозг автоматически принимает весь контекст как достоверный.

Лицо на фоне

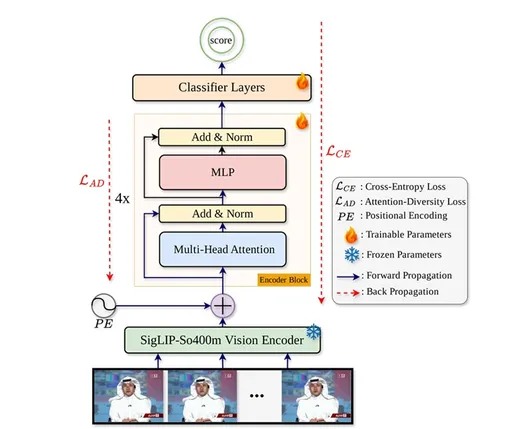

Система UNITE (Universal Network for Identifying Tampered and synthEtic videos) анализирует не только лица, но полные видеокадры, включая фон и паттерны движения. UNITE использует трансформер-архитектуру глубокого обучения для анализа видеоклипов. Система выявляет тонкие пространственно-временные несоответствия, которые упускают существующие методы. Описание разработки размещено на сервере препринтов arxiv.

Инновационный метод обучения «attention-diversity loss» заставляет систему мониторить множественные визуальные области в каждом кадре, предотвращая фокусировку только на лицах. В результате UNITE способен помечать широкий спектр подделок: от простых замен лиц до сложных полностью синтетических видео.

Разработка UNITE происходила в эпоху массового распространения text-to-video и image-to-video генераторов. Эти ИИ-платформы делают создание убедительных видеофейков доступным практически любому пользователю, создавая серьезные риски для личностей и институтов.

Команда представила исследование на конференции CVPR 2025 в Нэшвилле. Сотрудничество с Google обеспечило доступ к обширным датасетам и вычислительным ресурсам, необходимым для обучения модели на широком спектре синтетического контента.

Хотя система все еще находится в разработке, UNITE может стать важным инструментом борьбы с видеодезинформацией. Потенциальные пользователи системы — это социальные платформы, фактчекеры и редакции, работающие над предотвращением вирусного распространения поддельных видео.

Рохит Кунду говорит: «Люди имеют право знать, реально ли то, что они видят. И по мере того, как ИИ становится лучше в подделке реальности, мы должны становиться лучше в защите истины».