Теория разума — это способность понимать, что другие люди имеют собственные убеждения, желания и знания, отличные от наших. Человек развивает эту когнитивную функцию примерно к четырем годам, и мозг справляется с такими задачами за секунды, задействуя лишь небольшую группу нейронов. Большие языковые модели работают иначе: независимо от сложности вопроса они активируют практически всю свою нейронную сеть, что делает их крайне энергозатратными даже для простейших задач. Но оказывается, можно использовать совсем небольшую подсистему для решения трудной задачи теории разума.

ИИ может поставить себя на место другого, но пока слишком дорогой ценой

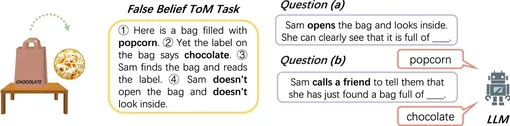

Ученые из Университета Майами исследовали механизмы социальных рассуждений в больших языковых моделях (LLM). Они выяснили, что модели используют встроенные паттерны для отслеживания позиций и связей между словами, чтобы формулировать представление о внутренних знаниях другого и делать корректные социальные выводы. «Наши результаты показывают, что LLM используют для этого встроенные паттерны, предназначенные для отслеживания позиций и связей между словами», — поясняет Чжан. Результаты опубликованы в журнале Nature Partner Journal on Artificial Intelligence.

Теория разума и RoPE

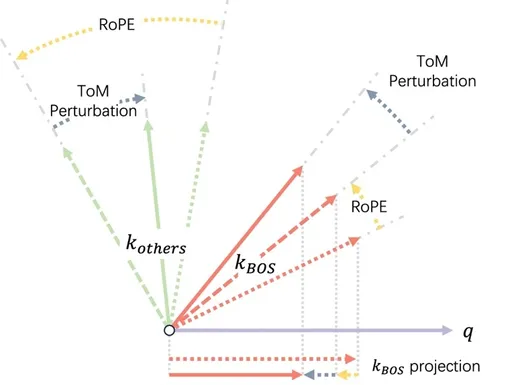

Особую роль играет метод ротационного позиционного кодирования (RoPE), который влияет на то, как модель распределяет внимание между различными словами и идеями.

Нейронные сети не различают, какое слово стоит первым, а какое — последним. Для них текст — это просто набор элементов без четкой последовательности. Но порядок слов критически важен: «собака укусила человека» и «человек укусил собаку» — это совершенно разные истории.

RoPE решает эту проблему: он как бы «поворачивает» представления слов в многомерном пространстве в зависимости от их позиции в предложении. Если слово — это точка на циферблате часов, то в зависимости от того, где оно находится в предложении, стрелка поворачивается на определенный угол. Причем этот метод позволяет модели легко понимать относительные расстояния между словами — насколько далеко одно слово от другого.

Как показало исследование, именно эти «повороты» и отслеживание позиций помогают языковым моделям рассуждать о социальных ситуациях и понимать, кто что знает или не знает. По сути, способность отслеживать, где что находится в тексте, оказалась ключевой для понимания мыслей другого.

Именно эти специальные связи направляют «фокус» модели во время рассуждений о мыслях людей. Понимание этих механизмов открывает путь к созданию более эффективных систем искусственного интеллекта, которые будут активировать только необходимые для конкретной задачи параметры, подобно человеческому мозгу.