Система работает как игра: математик формулирует теорему для подсистемы Lean proof assistant (помощник, умеющий доказывать) и пишет слово «sorry» вместо доказательства. AlphaProof пытается заполнить пробел, то есть вписать вместо «sorry» полное доказательство.

ИИ-модель AlphaProof доказывает теоремы и находит ошибки в определениях

Инструмент особенно эффективен при работе со стандартными определениями из библиотеки mathlib, но испытывает трудности с нестандартными концепциями. Математик Алекс Конторович из Ратгерского университета отметил: «Этот диалог между высказыванием утверждений и проверкой, можно ли их доказать или опровергнуть, был критически важен для правильной формализации». Работа опубликована в журнале Nature.

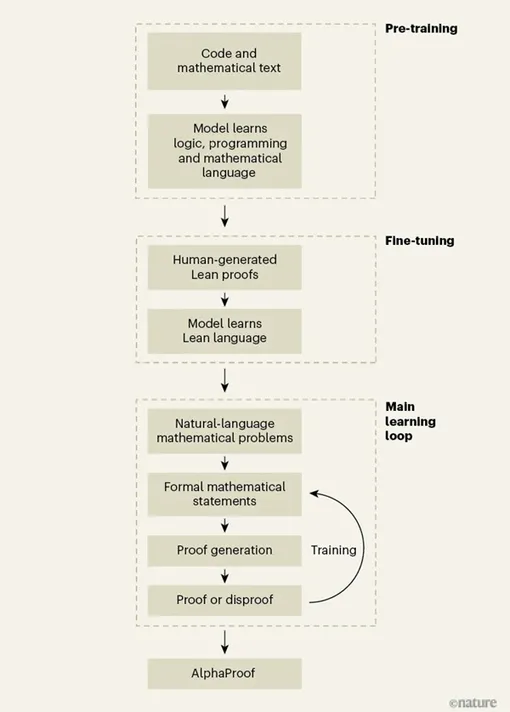

Обучение модели

Обучение AlphaProof состояло из трех этапов. Сначала модель изучала логику и математический язык на текстах с кодом. Затем проходила тонкую настройку на тысячах доказательств, написанных людьми в подсистеме Lean. Наконец, система использовала языковую модель на базе Gemini для перевода математических утверждений из научных статей в формат Lean — процесс, называемый автоформализацией. Для каждого утверждения создавалось несколько вариантов перевода, и AlphaProof училась на них, даже если перевод был неточным.

Не все математики нашли инструмент полезным. Кевин Баззард из Имперского колледжа Лондона работал над переводом доказательства Великой теоремы Ферма в Lean и столкнулся с множеством специфических определений, с которыми AlphaProof не справилась.