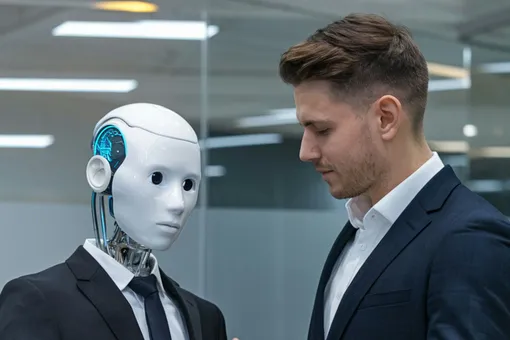

По мере того как разговоры о «сознательном ИИ» выходят за пределы научной фантастики и становятся частью этических и политических дебатов, возникает простой, но неудобный вопрос: а можем ли мы вообще понять, осознает ли машина себя?

Что будет, если ИИ обретет сознание, но мы никогда этого не узнаем?

Обретет ли ИИ сознание — и узнаем ли мы об этом

Том Макклелланд утверждает: у науки попросту нет инструментов, позволяющих проверить наличие сознания у искусственных систем.

Мы до конца не понимаем, как возникает сознание у людей и животных, а значит, не можем надежно распознать его у машин. В этой ситуации, считает Макклелланд, единственно честная позиция — агностицизм:

Важно и другое различие, которое часто теряется в публичных дискуссиях.

- Сознание само по себе еще не является этической проблемой.

- Ключевым фактором является чувствительность — способность испытывать удовольствие или страдание.

- Машина может обрабатывать информацию, распознавать образы и даже говорить о себе в первом лице, но это не означает, что она способна чувствовать боль или радость.

Будущее с ИИ

Философ предупреждает: неопределенность вокруг сознания ИИ создает почву для спекуляций.

Технологические компании могут использовать отсутствие строгих критериев как маркетинговый инструмент, представляя свои разработки как «следующий уровень разума», не имея для этого научных оснований.

- Такая риторика, по мнению эксперта, отвлекает внимание и ресурсы от более насущных этических проблем — там, где страдание живых существ гораздо более вероятно.

Отдельный риск связан с человеческой психологией. Том Макклелланд отмечает: люди уже сейчас формируют эмоциональные связи с чат-ботами, искренне считая их сознательными. Если эти связи строятся на ложном предположении, это может иметь разрушительные последствия для самих людей.

Вывод философа звучит сдержанно, но жестко: пока у нас нет надежных критериев и теории сознания, разговоры о «пробужденном ИИ» остаются вопросом веры и интуиции, а не науки.

И, возможно, самое ответственное решение — признать пределы нашего знания.