Современная наука стоит на пороге масштабного эксперимента: изучения человеческой природы без участия самих людей. Группы исследователей и стартап Simile работают над созданием симуляций, в которых ИИ-агенты воспроизводят сложные социальные взаимодействия, от бытовых разговоров до разрешения политических конфликтов и моделирования рыночных отношений.

Соцсети ИИ-агентов все точнее моделируют коллективное поведение людей

Начав с небольших поселений из 25 цифровых персонажей, ученые перешли к созданию детализированных копий конкретных личностей. Эти агенты способны не просто отвечать на вопросы, но и транслировать убеждения, характерные для их прототипов.

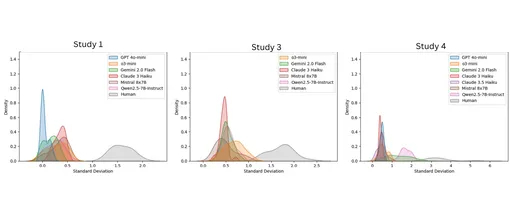

Одной из ключевых площадок для подобных исследований стала сеть Moltbook — пространство, напоминающее Reddit, но населенное миллионами ботов. Анализ их активности показывает, что алгоритмы склонны копировать коллективные паттерны, например, следовать за мнением большинства или реагировать на популярный контент. Но мотивы их действий остаются предметом дискуссий, так как внутренняя логика машин все еще серьезно отличается от человеческой психики.

Преграды на пути к цифровому сознанию

Основная трудность в создании полноценного виртуального общества заключается в том, что текущие языковые модели лишены человеческих слабостей и иррациональности. ИИ мастерски владеет логикой, но зачастую не способен на «мотивированное суждение», когда выводы делаются на основе эмоций или личных предпочтений, а не только фактов. Кроме того, существующие модели склонны к сикофантии — стремлению поддакивать пользователю и зеркально отражать его ошибки, чтобы казаться полезными.

Тем не менее, границы между мирами постепенно стираются. Ученые уже используют ИИ для предсказания политических взглядов, основываясь на данных прошлых лет, и отмечают, что люди все чаще ищут у ботов эмоциональную поддержку. Предстоящие годы станут временем, когда различие между социальным поведением человека и его программной имитацией может окончательно исчезнуть, открывая новые горизонты для социологии и управления общественными процессами.