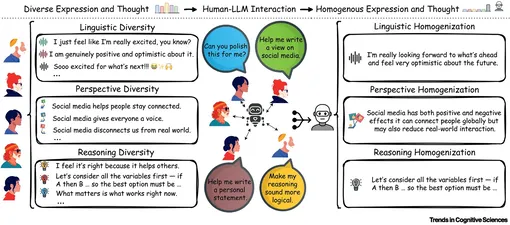

Современные нейросети обучаются на колоссальных массивах данных, созданных людьми, однако сегодня наблюдается обратный процесс: алгоритмы начинают «перепрошивать» своих создателей. Исследователи фиксируют пугающую тенденцию — пользователи больших языковых моделей непроизвольно перенимают их манеру аргументации, структуру предложений и даже специфический лексикон. Работа опубликована в журнале Trends in Cognitive Science.

Использование ИИ-чатов может привести к «унификации» человечества

Это приводит к постепенному вымыванию индивидуальности и формированию предсказуемого, «усредненного» стиля общения. Если раньше каждый автор обладал уникальным творческим почерком, то широкое внедрение ИИ превращает информационное поле в пространство стилистической монотонности. Феномен затрагивает не только тех, кто напрямую использует чат-боты, но и окружающих, которые начинают воспринимать упрощенные конструкции как социальную норму.

Особую опасность представляет когнитивная деформация. В ходе экспериментов выяснилось, что люди склонны менять свои взгляды на острые социальные темы после взаимодействия с нейросетью, даже не осознавая этого влияния.

Живар Сурати, соавтор работы, подчеркивает масштаб проблемы: «Если люди вокруг вас взаимодействуют с этими моделями и перенимают их стиль письма, взгляды и логику, в какой-то момент это окружит вас настолько, что станет казаться наиболее социально правильным способом подачи информации». Инструменты, призванные повысить эффективность, превращаются в невидимые фильтры, сужающие диапазон человеческого восприятия и лишающие общество интеллектуального многообразия.

Сопротивление алгоритму

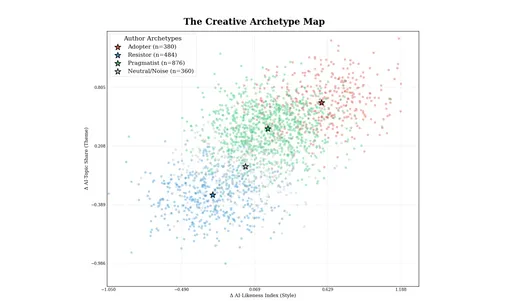

Несмотря на мощное давление технологической среды, человеческий разум сохраняет механизмы защиты. Последние данные препринтов показывают, что не все пользователи поддаются эффекту «выравнивания». Существует категория авторов, которая в ответ на экспансию ИИ начинает писать еще более выразительно и специфично, подчеркивая свою аутентичность.

Это своего рода культурное сопротивление, которое отстаивает ценность человеческого своеобразия, противопоставляя его машинной гладкости. Более того, эксперименты с созданием множества цифровых «личностей» с разным культурным бэкграундом показывают, что разнообразие можно поддерживать искусственно, если не давать алгоритмам скатываться к одной усредненной модели. Но без осознанного контроля со стороны общества риск превращения человечества в коллективное эхо нейросети остается критически высоким.