Как мы понимаем, насколько удален от нас предмет? Каждую секунду наш мозг сопоставляет два немного разных изображения – от левого и правого глаза – и на основе разницы между ними строит трехмерную карту мира.

Стереозрение: новый алгоритм позволит роботам лучше видеть мир

Стереосистемы роботов и беспилотных автомобилей устроены подобной зрению человека. Только вместо глаз они используют камеры, а вместо мозга — алгоритмы. Но этот механизм срабатывает не везде. Например, при встрече с идеально белой стеной или зоной с повторяющимися узорами, алгоритму не хватает визуальных зацепок, чтобы верно сопоставить изображения. Могла бы помочь ручная разметка с правильным расстоянием до каждого объекта, но работать она будет только в ограниченном сценарии.

Новый фреймворк для обучения нейросетей, разработанный международной командой ученых, помогает преодолеть этот барьер. Они вводят в процесс обучения «наставника» — модель Depth Anything V2, которая умеет оценивать относительную глубину только с помощью «одного глаза» — одного изображения.

«Модель Depth Anything V2 постоянно передает подсказки стереосистеме. Например, "Я не знаю, на сколько метров эта машина ближе дерева, но она точно ближе, и граница между ними должна быть резкой" или "На этой стене, где нет контраста, глубина должна меняться плавно"», — пояснил Александр Дворкович, руководитель проекта Научно-технического центра телекоммуникаций МФТИ.

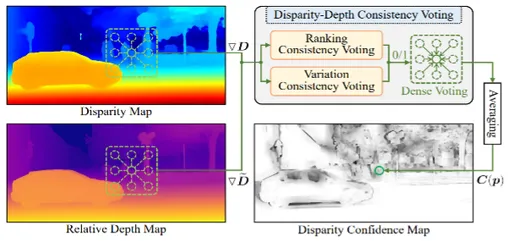

Система работает в три этапа. Сначала алгоритм оценки диспаратности (смещения) проверяет каждый пиксель, соответствуют ли его данные подсказкам «наставника», и помечает их зеленым (верно) и красным (ошибка) цветом. Затем функция потерь на основе локального ранжирования глубины ищет вокруг каждой красной точки несколько зеленых соседей. Подобно маякам, они задают границы и сдвигают красный пиксель на нужное место.

Наконец, алгоритм «Двойная функция потерь сглаживания диспаратности DDS» помогает построить контуры. Она убирает цифровой шум там, где «наставник» говорит, что цвет должен быть равномерным, и наоборот.

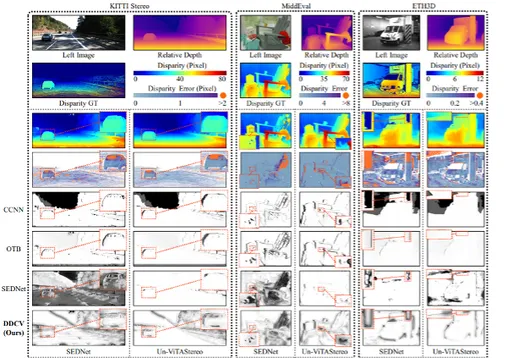

По словам разработчиков, систему уже протестировали на стандартных датасетах. Результат — превосходство Un-ViTAStereo среди аналогов на бенчмарке. Например, при тестировании беспилотников удалось снизить долю грубых ошибок до 5%. Это значит, что при движении автомобиль будет лучше понимать расстояние до объектов, в том числе до пешеходов.

Текущая версия Un-ViTAStereo — только начало. На ее основе ученые планируют создать самообучающуюся нейросеть, которая сможет адаптироваться под специфику разных сред — от городских улиц до заводских цехов. Также будут использоваться редкие, но точные измерения лидаров в качестве «супермаяков» для обучения, что еще больше повысит точность.

Исследование опубликовано в IEEE Transactions on Circuits and Systems for Video Technology.