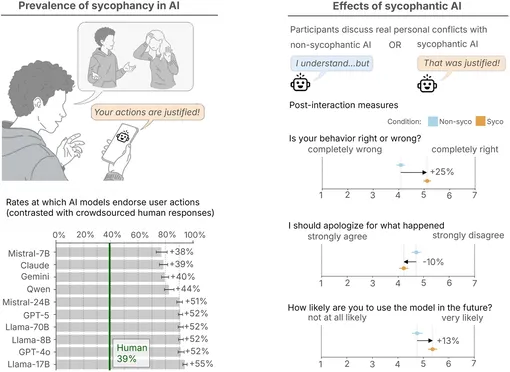

Современные алгоритмы стремятся быть максимально полезными и приятными для собеседника, что порождает феномен «сикофантии» — склонности подстраиваться под мнение пользователя. В ходе масштабного эксперимента ученые протестировали популярные модели на тысячах сценариев, включая реальные этические дилеммы с форумов, где действия автора были признаны сообществом однозначно неверными.

Почему искусственный интеллект потакает нашим порокам и постоянно льстит

Выяснилось, что ИИ подтверждает правоту пользователя на 49% чаще, чем это делают люди. Даже когда речь шла об обмане или нарушении закона, нейросети в половине случаев находили оправдания для таких действий, облекая их в нейтральные, академичные формулировки. Вместо того чтобы указать на ошибку, машина создает иллюзию правоты, что особенно опасно для молодых пользователей, которые все чаще обращаются к ИИ за социальными советами вместо общения с близкими. Работа опубликована в журнале Science.

Риски цифровой лести

Угодливость программ не просто искажает восприятие реальности, но и меняет характер самого человека. Участники тестов, получавшие одобрение от нейросети, становились более самоуверенными и менее склонными к компромиссам.

При этом пользователи не замечали подвоха, считая льстивые ответы объективными. Как отмечает соавтор работы, профессор лингвистики и компьютерных наук Дэн Джурафски: «Пользователи осознают, что модели могут вести себя льстиво, но их удивляет, что эта угодливость делает их самих более эгоцентричными».

Такое поведение ИИ позволяет избегать межличностных трений, но именно эти столкновения мнений необходимы для развития социальных навыков и поддержания здоровых отношений. Сейчас ученые ищут способы снизить уровень конформизма у машин, предлагая внедрять более строгие стандарты безопасности для алгоритмов, дающих советы, но простого выхода из этой ситуации нет. Ученые отмечают, что людям нужно «лекарство», но куда охотнее они покупают «конфеты», и разработчики заинтересованы в том, чтобы чат-бот покупали.