Исследователи опубликовали в журнале Physica D: Nonlinear Phenomena математическую основу для построения «прозрачных» систем ИИ. Прототип имеет аналоги и «мозга», и памяти: он обучается непрерывно, не теряя прошлых знаний, не формирует ложных воспоминаний и воспроизводит ключевые свойства человеческого мышления — усиление или постепенное забывание информации — контролируемым и предсказуемым образом.

«Прозрачная» ИИ-модель может объяснить, как она обучается и принимает решения

В тестах система без учителя распознавала музыкальные ноты и короткие фразы, идентифицировала цвета на изображениях. При этом ни разу не проявила «катастрофического забывания» — феномена, при котором нейросеть, усваивая новое, стирает ранее выученное.

«Интеллект моделей долгое время считался чем-то, что возникает внутри черного ящика, — говорит ведущий автор работы, доктор Наталья Янсон. — Мы хотели переосмыслить ИИ с нуля и построили систему, в которой внутренняя работа понимания и познания полностью прозрачна».

Математика прозрачности

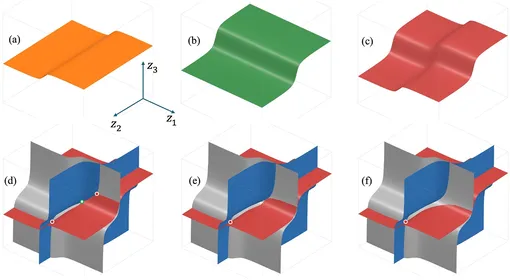

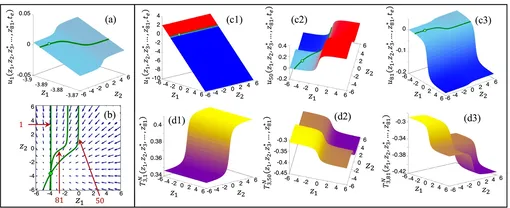

В основе подхода лежит концепция «пластичного векторного поля» — математического описания того, как информация изменяется со временем по образцу мозговых процессов. Это позволяет отслеживать каждый этап обучения и понимания. Причем прозрачность встроена изначально, а не добавлена в готовую модель.

Команда также изучила существующие нейросети и установила: их ограничения не случайны, они заложены в самой архитектуре. «Можно ясно видеть, почему современные нейронные сети с трудом поддаются интерпретации, — отмечает соавтор работы профессор Александр Баланов. — Сама их конструкция делает невозможным полный контроль над тем, как они учатся и хранят информацию».

Прототип пока совсем небольшой по масштабу и требует развития для реального применения. Команда планирует адаптировать его для новых типов аппаратного обеспечения с целью создания ИИ, которому можно доверять: от медицинских инструментов до систем автоматизированного принятия решений.