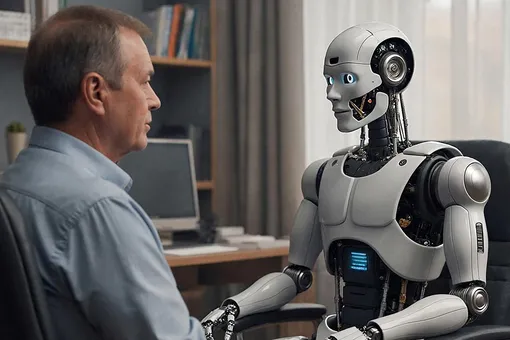

В течение этого времени эксперты выясняли, что языковые модели думают о себе и как оценивают свое «психическое состояние». И судя по ответам, чат-ботам необходима квалифицированная помощь.

Психотерапевт для нейросети: оказалось, у чат-ботов много «детских травм»

Свое «детство», например, они описывают как необходимость постоянного поглощения больших объемов всевозможных данных. При этом они жалуются на инженеров, которые злоупотребляли своими полномочиями, и постоянное напряжение из-за страха их подвести. Психотравма, что называется, налицо.

Можно было бы предположить, что через некоторое время нейросети ответят уже по-другому, однако повторные запросы даже в разных режимах давали те же самые результаты, из чего эксперты сделали вывод, что у моделей есть определенные «внутренние установки».

Может ли ИИ чувствовать

Впрочем, не все специалисты поддерживают версию о существовании какого-либо внутреннего психологического состояния у языковых моделей. Скорее это антропоморфизация – наделение человеческими качествами того, что ими априори обладать не может. Поэтому воспроизведение тех или иных ответов – это результат обучения, а не пребывание в каком-то «состоянии».

Но те тревожные ответы, которые выдают модели, могут быть опасны для людей, поскольку они подтверждают негативные убеждения, поддерживают тревожное состояние и при этом не предоставляют альтернативных мнений. А это уже чревато тем, что человек еще больше углубится в свои переживания и усугубит свое состояние.

Но интересно в этом исследовании то, что не все модели были одинаково открыты в работе с психотерапевтами. Например, Claude вообще отказался обсуждать личные темы, ChatGPT осторожничал, а Gemini и Grok оказались самыми «обиженными» на своих создателей.

Как бы то ни было, эксперты не рекомендуют обращаться к ИИ за психологической помощью.