Такой вывод эксперты сделали после серии экспериментов, для которых они разработали уникальные дипфейки. В одном видео некий чиновник признавался в том, что берет взятки, а в другом – веган рассказывал подписчикам о том, что ест мясо.

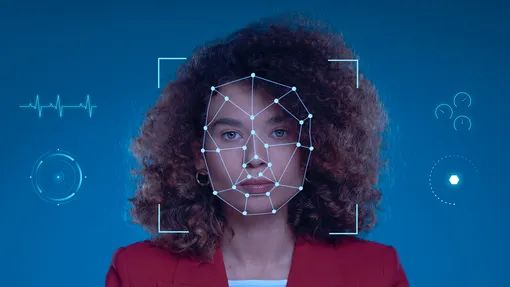

Обман без границ: почему люди игнорируют предупреждения и верят дипфейкам

Все это показывали 600 добровольцам. Одной группе демонстрировали ролики с настоящими актерами, а другой – дипфейки. При этом некоторых зрителей не предупреждали о дипфейках, вторым просто напоминали о том, что они существуют, а для третьих высвечивалось конкретное предупреждение о том, что видео поддельное.

Задача у всех была простая: определить, выглядит ли видео фейковым, предположить, насколько герой виновен в своем проступке, и был ли этот проступок в принципе.

Результаты экспериментов

Как и ожидалось, плашка, предупреждающая о том, что перед участниками – дипфейк, частично срабатывала: добровольцы признавали то, что перед ними сгенерированное видео, но это не помешало им дать моральную оценку проступкам героев.

А вот уведомление о существовании дипфейков заставили добровольцев усомниться в подлинности всего просмотренного контента. То есть они не отличили дипфейк от реальности, но на всякий случай перестали слепо доверять информации.

Психологи, основываясь на этих экспериментах, предупреждают, что маркировка контента далеко не всегда выполняет свою функцию. Люди оценивают образы, которые им демонстрируют в видео, и формируют мнение на основе своих эмоций, а не рациональных знаний.

Так что обязательная маркировка контента, созданного при помощи ИИ, идея отчасти провальная, и нужно искать другие пути предупреждения людей о необходимости быть более внимательными и не забывать про критическое мышление.