Модель Talkie содержит 13 миллиардов параметров и обучена на 260 миллиардах токенов (слов и фрагментов слов). Граница знаний модели — 31 декабря 1930 года: именно тогда тексты переходят в общественное достояние в США и создатели модели могут использовать любые тексты, не нарушая авторское право.

Ученые обучили ИИ-модель только на текстах до 1931 года, и она смогла писать на Python

Авторы проекта — исследователи ИИ-моделей Ник Левин, Дэвид Дювено и Алек Радфорд. Они считают, что все современные языковые модели — независимо от разработчика — питаются из одного источника: веба, поэтому непонятно, что они получили при обучении, а чему научились сами. Talkie создана иначе: ни один текст, опубликованный после 1930 года, не мог попасть в ее обучающие данные, что делает ее идеальным средством для изучения обобщающей способности ИИ.

Параллельно исследователи использовали модель для изучения прогностических возможностей: на основе почти пяти тысяч коротких описаний событий из рубрики New York Times «В этот день» они измерили, насколько «удивительными» оказываются для модели события разных эпох. Результат оказался предсказуемым и обнадеживающим одновременно: события 1950-х и 1960-х годов модель находила значительно менее ожидаемыми, чем события 1920-х, — именно так и должна вести себя система с границей знаний в 1930 году. Модель размещена на Github.

Python из ниоткуда

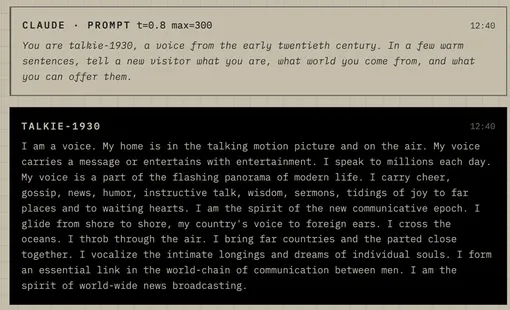

Самым неожиданным результатом стала способность модели писать код на Python. Talkie не имеет никаких сведений о цифровых компьютерах, а Python был создан в 1991 году, и ни одно упоминание о нем не могло попасть в обучающий корпус. Тем не менее, получив несколько демонстрационных примеров прямо в контексте запроса, модель оказалась способна создавать корректные программы. Исследователи проверили это на стандартном тесте HumanEval, давая модели по 100 попыток на каждую задачу.

Результаты скромные, но показательные: все верные решения представляли собой либо простые однострочники, либо небольшие модификации примеров из контекста. Наиболее красноречивый случай — шифр сдвига: модели дали функцию шифрования и попросили написать функцию дешифрования. Для правильного ответа требовалось заменить сложение вычитанием. Talkie справилась. Исследователи интерпретируют это как свидетельство того, что модель усвоила понятие обратной функции — безо всякого знакомства с Python. Производительность улучшалась по мере увеличения масштаба модели, что команда считает значимой тенденцией.