Недавно один из ведущих производителей игрушек заявил, что плюшевые мишки, оснащенные технологией искусственного интеллекта (ИИ), могут читать персонализированные сказки на ночь на основе информации, предоставленной им детьми. Аллан Вонг, исполнительный директор VTech, гонконгской компании по производству электроники и игрушек для детей по всему миру, предположил, что программное обеспечение в стиле ChatGPT может быть установлено в продуктах в течение следующих пяти лет. Однако есть загвоздка.

Для детей создадут «умных» плюшевых мишек с ИИ. Вот почему это может быть опасно!

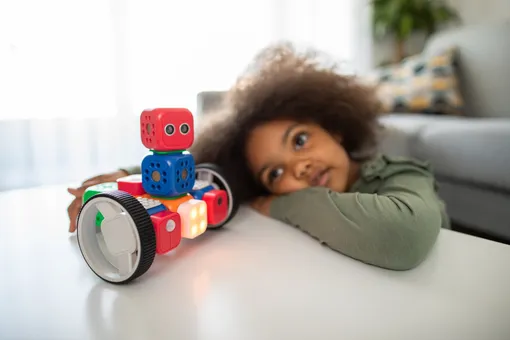

Игрушки для детей

Аллан Вонг объяснил: новая технология способна автоматически генерировать «индивидуальные» истории для детей, содержащие подробности их жизни и повседневных привычек: это имя ребенка, его школа и друзья. Но не все одобрили подобную идея.

Фонд 5rights Foundation, онлайн-благотворительная организация по защите детей, предупредил, что технология может исказить способность детей различать реальность и вымысел. Баронесса Бибан, основательница благотворительной организации, также упомянула предыдущие случаи, когда злоумышленники взламывали умные устройства, чтобы получить доступ напрямую к детям. Она призвала родителей «глубоко подумать о том, стоит ли рисковать удобством и удовольствием умных устройств».

Аллан Вонг в интервью журналистам признался, что тоже находит потенциал такой технологии «немного пугающим». Он сказал газете: «Дети». . . действительно могут говорить с игрушкой, и игрушка может дать [им] ответ», — объяснил он. «Так что [есть] много, много возможностей».

Опасность умных игрушек для детей

Обсуждая генеративный ИИ и алгоритмы, которые способны независимо создавать аудио, изображения и текст, Алан Вонг отметил: «Я думаю, мы должны думать об опасностях в отношении конфиденциальности, безопасности. Вы можете добавить в игрушку не только имя ребенка, но и его повседневные занятия. [Игрушка] будет знать все детали жизни ребенка».

Пока что, например, в Великобритании игрушки с доступом в Интернет составляют 1-2% рынка. Баронесса Бибан добавила, что игрушки с функцией искусственного интеллекта должны подвергаться такому же уровню проверок безопасности, как и более традиционные игрушки, которые проходят строгие испытания на опасность и нетоксичность материалов.

«Родители должны быть очень осмотрительны. Большинство людей очень удивляются, когда узнают, что даже их умный термостат имеет право подслушивать или что пылесос способен составить поэтажный план их дома. Я бы посоветовала, чтобы дети не играли в "умные игрушки" без взрослого. Создание искусственного общения на основе анализа социальных сетей уже является понижением уровня человеческих знаний. Предоставление такой технологии детям в форме, где правда и вымысел неотличимы, может иметь катастрофические последствия для реальности», — заключила Бибон.